W tym artykule skupię się na omówieniu obowiązków, jakie spoczywają na dostawcach platform internetowych na podstawie aktu o usługach cyfrowych (AUC).

Pod platformy internetowe kwalifikuje się wiele usług. Mogą nimi być media społecznościowe (np. usługi Meta, jak Facebook czy Instagram), usługa typu market place (np. Allegro, Amazon), czy też miejsca umożliwiające publikowanie filmów (np. Youtube). W ciągu ostatnich lat świadczenie usług w formie platform internetowych stało się jednym z przodujących sektorów gospodarki cyfrowej. Dlatego też prawodawca unijny postanowił poświęcić bardzo dużo uwagi tym podmiotom podczas tworzenia AUC i nałożył na nie szereg obowiązków.

Kim jest dostawca platformy internetowej?

Na samym początku należy wskazać, kim jest dostawca platformy internetowej.

Platformą internetową w myśl AUC jest usługa hostingu (więcej informacji na ten temat znajdziecie na naszym blogu w artykule [__]), która na żądanie odbiorcy usługi przechowuje i rozpowszechnia publicznie informacje.

AUC przewiduje jednak wyjątki od tego, czy konkretna usługa kwalifikuje się jako platforma internetowa. Z takim wyłączeniem mamy do czynienia, gdy działanie jest nieznaczną lub wyłącznie poboczną cechą innej usługi lub nieznaczną funkcją głównej usługi, i ze względów obiektywnych i technicznych nie można z niej skorzystać bez takiej innej usługi, a włączenie takiej cechy lub funkcji w taką inną usługę nie jest sposobem na obejście stosowania AUC.

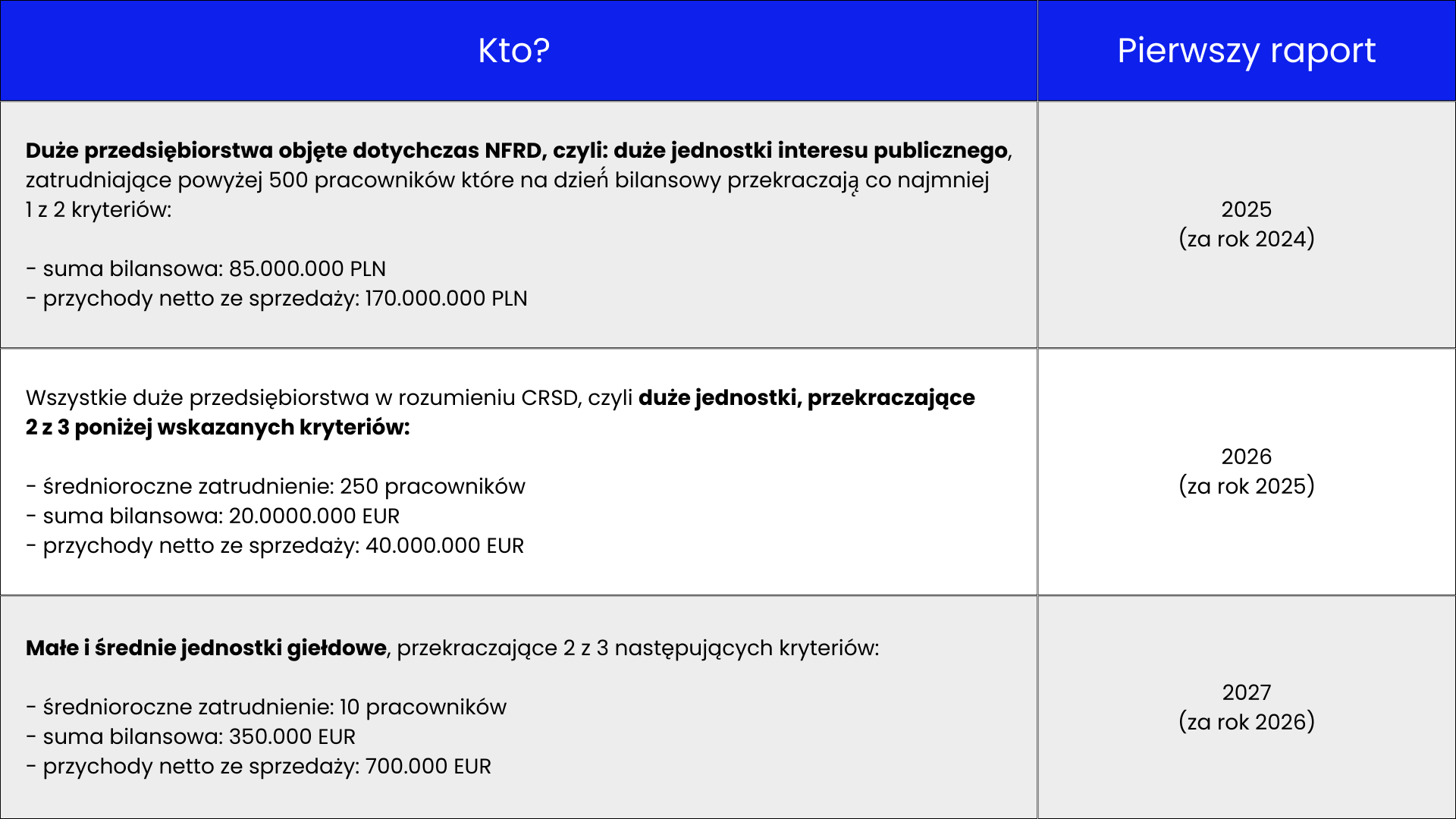

Samo ustalenie, że konkretny dostawca spełnia przesłanki bycia platformą internetową, wcale nie oznacza, że konieczne będzie stosowanie w tym zakresie AUC. Jeżeli dostawca jest mikro lub małym przedsiębiorstwem w myśl zaleceń Komisji Europejskiej 2003/361/WE, wówczas – poza jednym wyjątkiem sprawozdawczym – nie będzie zobowiązany do wdrożenia rozwiązań przewidzianych dla dostawców platformy internetowej. Są to następujące przedziały:

– mikro przedsiębiorstwo – zatrudnia mniej niż 10 pracowników, a jego obrót lub roczna suma bilansowa nie przekracza 2 mln EUR;

– małe przedsiębiorstwo – zatrudnia mniej niż 50 pracowników, oraz których obrót lub roczna suma bilansowa nie przekracza 10 mln EUR.

Ale i tutaj mamy wyjątek od wyjątku 😊 Nawet jeżeli dostawca platformy internetowej jest mikro lub małym przedsiębiorstwem, będzie musiał przestrzegać tych obowiązków, jeżeli jednocześnie będzie posiadał status dostawcy bardzo dużej platformy internetowej. Wynika to z tego, że przy takiej kwalifikacji nie ma znaczenia rozmiar dostawcy, a przede wszystkim jego zasięgi (o czym więcej poniżej).

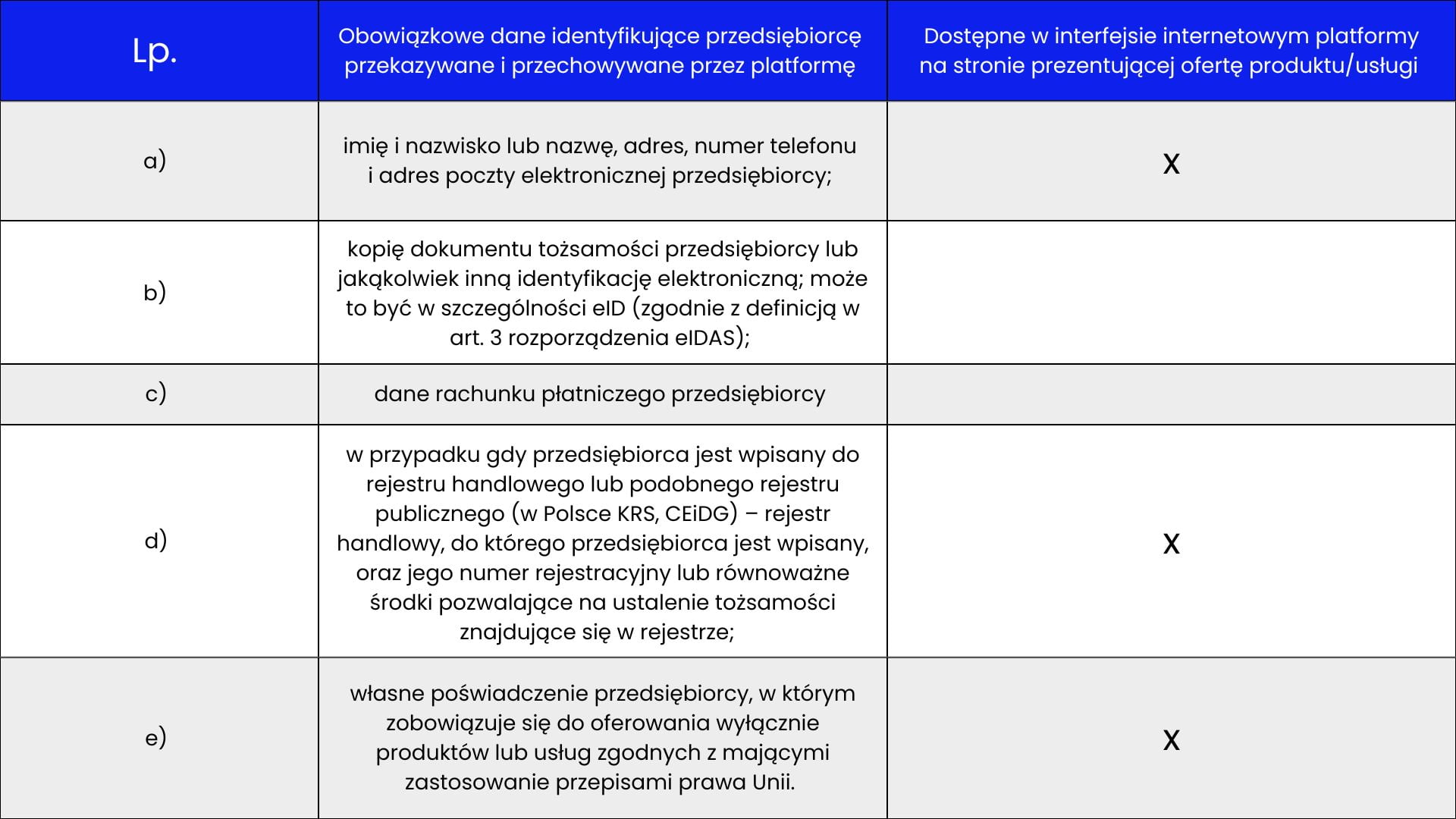

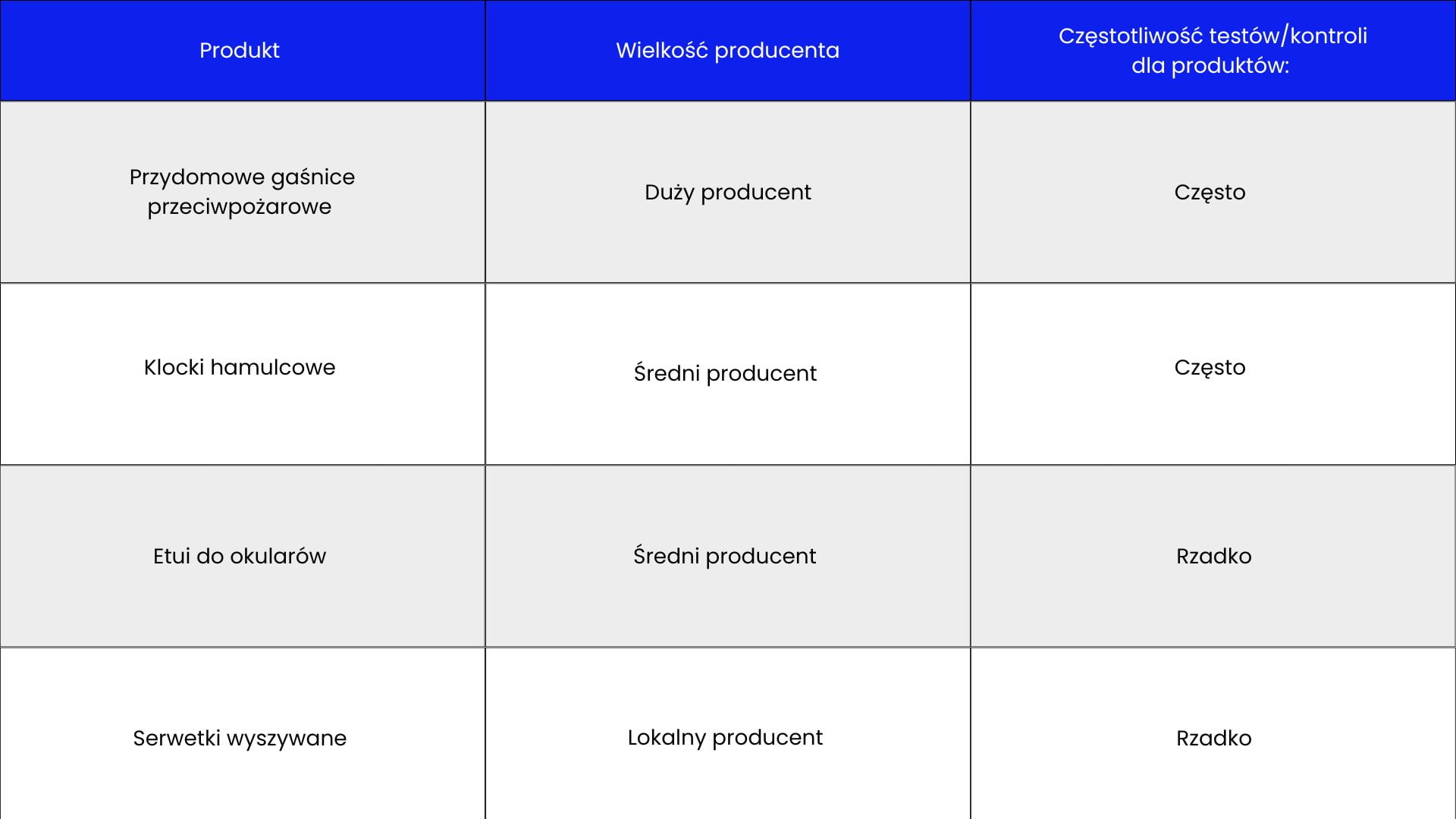

Poniżej ogólne zestawienie obowiązków przewidzianych wyłącznie dla dostawców platform internetowych z AUC (Rozdział III Sekcja 3 AUC):

Ale uwaga! Musimy jeszcze pamiętać o poniższych zasadach:

- Dostawca platformy internetowej musi spełniać również obowiązki, jakie są przewidziane dla każdego dostawcy usług pośrednich (Rozdział III Sekcja 1 AUC) oraz dostawcy usług hostingu (Rozdział III Sekcja 2 AUC). Wynika to z tego, że dostawca platformy internetowej z założenia jest również dostawcą hostingu, czyli jednego z rodzajów usług pośrednich.

- Kolejne obowiązki dla dostawcy platformy internetowej pojawią się, jeżeli jego platforma umożliwia konsumentom zawieranie z przedsiębiorcami umów zawieranych na odległość (tzw. platformy B2C) (Rozdział III Sekcja 4 AUC).

- Jeszcze więcej obowiązków wystąpi, kiedy dostawca będzie posiadał status dostawcy bardzo dużej platformy internetowej, czyli posiadał średnią liczbę miesięcznie aktywnych odbiorców usługi w Unii wynoszącą co najmniej 45 mln i został wskazany przez Komisję Europejską jako bardzo duża platforma internetowa.

- Last but not least, niezależnie od obowiązków nałożonych przez AUC, dostawca platformy internetowej musi spełniać obowiązki, jakie są na niego nałożone w innych aktach prawnych (jak np. rozporządzenia 2021/784 w sprawie przeciwdziałania rozpowszechnianiu w internecie treści o charakterze terrorystycznym, czy też RODO).

Poniżej skrótowo obowiązki dostawców platform internetowych, jakie wymieniłem powyżej.

Wewnętrzny system rozpatrywania skarg

Jest to rozwinięcie nałożonych na każdego dostawcę usługi obowiązków związanych z moderacją treści w swoich zasobach. Dostawca platformy internetowej musi umożliwić odbiorcom usługi, w tym osobom, które dokonują zgłoszenia, przez okres co najmniej sześciu miesięcy od podjęcia decyzji związanej z moderacją dostęp do skutecznego wewnętrznego systemu rozpatrywania skarg.

Dla przykładu, załóżmy że użytkownik A zauważył, że na platformie internetowej XYZ użytkownik B zamieścił komentarz, który narusza dobra osobiste użytkownika A. Użytkownik A zgłosił do dostawcy platformy internetowej XYZ o występowaniu tych nielegalnych treści. Po pewnym czasie dostawca platformy wydał decyzję, w której przychylił się do stanowiska użytkownika A i usunął z platformy XYZ treści komentarz użytkownika B, który został o tym fakcie poinformowany. Użytkownik B nie zgadza się z taką decyzją, dlatego składa na nią skargę, która będzie rozpatrywana przez właśnie wewnętrzny system rozpatrywania skarg tego dostawcy.

Oczywiście jest to jeden ze scenariuszy, kiedy wewnętrzny system rozpatrywania skarg znajduje zastosowanie.

Więcej informacji o tej procedurze znajdziecie w tym artykule.

Pozasądowy mechanizm rozstrzygania sporów

Kolejnym obowiązkiem, jaki spoczywa na dostawcach platform internetowych, jest zapewnienie użytkownikom i osobom uprawnionym (tj. osobom dokonującym zgłoszenia, które nie są użytkownikami) możliwości skorzystania z pozasądowego mechanizmu rozstrzygania sporów.

Należy pamiętać, że nie jest to kolejny etap rozpatrywania sprawy przez dostawcę platformy internetowej. Sprawa jest rozstrzygana przez zewnętrzny podmiot. Dostawca platformy internetowej musi wskazać zainteresowanemu, że prawo skorzystania z tego środka.

Zainteresowany może skierować wniosek o rozwiązanie sporu do pozasądowego (np. certyfikowanego) organu. Co do zasady dostawca platformy internetowej nie może odmówić przystąpienia do takiej sprawy.

Priorytetowe traktowanie zgłoszeń

Na dostawcy platformy internetowej spoczywa obowiązek wdrożenia w swojej organizacji niezbędnych środków technicznych i organizacyjnych w celu zapewnienia priorytetowego traktowania zgłoszeń dokonywanych przez zaufane podmioty sygnalizujące. Są to podmioty wskazane przez koordynatora ds. usług cyfrowych, które:

- dysponują szczególną wiedzą ekspercką i kompetencjami do celów wykrywania, identyfikowania i zgłaszania nielegalnych treści;

- są niezależne od dostawców platform internetowych;

- podejmują działania mające na celu dokonywanie zgłoszeń w sposób dokładny i obiektywny oraz z zachowaniem należytej staranności.

Spełnienie takiego obowiązku może się wiązać np. z ustanowieniem osobnego kanału zgłoszeń dla tych podmiotów, niezależnie od zgłoszeń dokonywanych przez inne osoby.

Mechanizmu reagowania na nadużycia w korzystaniu usług

AUC nakłada na dostawcy platformy internetowej wdrożenie mechanizmów, z których ten może skorzystać, gdy nadużywa się z udostępnianych przez niego usług. Bardzo często są to osoby uprawiające „trolling”.

Po pierwsze, dostawca zawiesza na rozsądny okres i po wydaniu uprzedniego ostrzeżenia świadczenie usług na rzecz odbiorców usługi często przekazujących oczywiście nielegalne treści.

Po drugie, dostawca zawiesza na rozsądny okres i po wydaniu uprzedniego ostrzeżenia rozpatrywanie zgłoszeń dokonanych za pośrednictwem mechanizmów zgłaszania i działania oraz skarg wnoszonych za pośrednictwem wewnętrznych systemów rozpatrywania skarg przez osoby lub podmioty dokonujące często oczywiście bezzasadnych zgłoszeń lub przez skarżących wnoszących często oczywiście bezzasadne skargi.

Dla przykładu, użytkownik A, mający konto w platformie społecznościowej XYZ, zgłasza jej dostawcy jako potencjalne nielegalne treści każdy wpis użytkownika B, który dotyczy sytuacji politycznej w kraju. Użytkownik A nie zgadza się z poglądami użytkownika B, ponieważ sam opowiada się za inną opcją polityczną. Natomiast już bez potrzeby posiadania wiedzy eksperckiej dostawca platformy XYZ zauważa, że żadna z wypowiedzi użytkownika B nie zawiera treści nielegalnych, a same wypowiedzi są konstruktywną krytyką. W takiej sytuacji dostawca platformy XYZ zwraca się do użytkownika A z ostrzeżeniem, że ten nadużywa swoich uprawnień zgłoszeniowych i wzywa do zaprzestania tych praktyk. Pomimo wezwania, użytkownik A dalej dokonuje zgłoszeń wypowiedzi użytkownika B. W związku z tym dostawca zawiesza na czas 1 miesiąca rozpatrywanie zgłoszeń użytkownika A.

Dodatkowe obowiązki sprawozdawcze

Dostawca platformy internetowej posiada więcej obowiązków sprawozdawczych, niż standardowy dostawca usług pośrednich. Poniżej przykładowe obowiązki w tym zakresie.

Poza informacjami zawartymi w art. 15 AUC (więcej informacji w artykule pod tym linkiem), dostawca platformy internetowej musi podać do publicznej wiadomości (najczęściej na stronie internetowej platformy internetowej) również następujące dane:

- związane z prowadzeniem przez dostawcę platformy internetowej sporów:

- liczbę sporów przekazywanych do organów pozasądowego rozstrzygania sporów;

- wyniki rozstrzygania tych sporów oraz

- medianę czasu potrzebnego na przeprowadzenie postępowania w sprawie rozstrzygania sporów, a także

- udział sporów, w których dostawca platformy internetowej wdrożył decyzje tego organu.

- liczbę przypadków zawieszenia świadczenia usług z podziałem na zawieszenia dokonane w związku z:

- przekazywaniem treści oczywiście nielegalnych;

- dokonywaniem oczywiście bezzasadnych zgłoszeń; oraz

- wnoszeniem oczywiście bezzasadnych skarg.

Ponadto co najmniej raz na sześć miesięcy dostawcy, w odniesieniu do każdej platformy internetowej lub wyszukiwarki internetowej, publikują w publicznie dostępnej sekcji swojego interfejsu internetowego informacje na temat średniej liczby aktywnych miesięcznie odbiorców usługi w Unii.

Jednocześnie dostawcy platform internetowych lub wyszukiwarek internetowych przekazują koordynatorowi ds. usług cyfrowych właściwemu dla miejsca siedziby i Komisji Europejskiej – na ich wniosek i bez zbędnej zwłoki – informacje o średniej liczbie aktywnych miesięcznie odbiorców w Unii.

Zakaz wykorzystywania dark patterns

Dostawca platformy internetowej nie może projektować, organizować ani obsługiwać swoich interfejsów internetowych w sposób, który wprowadza w błąd odbiorców usługi lub nimi manipuluje lub w inny istotny sposób zakłóca lub ogranicza zdolność odbiorców ich usługi do podejmowania wolnych i świadomych decyzji. AUC nazywa tego typu praktyki „zwodniczymi interfejsami internetowymi”, jednak w najczęściej biznes posługuje się zwrotem „dark patterns”. Stosowanie dark patterns jest niezwykle często występującym zjawiskiem, m.in. w e-commerce. Przez takie interfejsy użytkownicy często kupują produkty, których w ogóle nie potrzebują, czy też kupują je w ilości większej niż to niezbędne.

Należy tutaj zauważyć, że pierwszeństwo stosowania przed przepisem AUC w tym zakresie mają regulacje RODO oraz dyrektywy o nieuczciwych praktykach rynkowych (w polskim porządku prawnym implementowanej jako ustawa o przeciwdziałaniu nieuczciwym praktykom rynkowym).

Transparentność reklam internetowych

Dostawcy platform internetowych, którzy prezentują reklamy na swoich interfejsach internetowych, zapewniają, aby – w odniesieniu do każdej konkretnej reklamy prezentowanej każdemu indywidualnemu odbiorcy – odbiorcy usługi byli w stanie w sposób jasny, wyraźny, zwięzły i jednoznaczny oraz w czasie rzeczywistym:

- stwierdzić, że informacje są reklamą;

- stwierdzić, w imieniu jakiej osoby fizycznej lub prawnej jest prezentowana reklama;

- stwierdzić, jaka osoba fizyczna lub prawna zapłaciła za reklamę, jeżeli osobą tą nie jest osoba fizyczna lub prawna, o której mowa w lit. b;

- znaleźć istotne informacje, pozyskane bezpośrednio i łatwo z reklamy, na temat głównych parametrów wykorzystanych do określenia odbiorcy, któremu reklama jest prezentowana i, w stosownych przypadkach, sposobu zmiany tych parametrów.

W dodatku dostawcy zapewniają odbiorcom usługi funkcję umożliwiającą składanie oświadczenia, czy przekazywane przez nich treści są informacjami handlowym lub zawierają informacje handlowe (widzicie czasem na platformach, że konkretny materiał jest „sponsorowany”? 😊).

Kolejnym istotnym obowiązkiem nałożonym na dostawców platform internetowych jest zakaz prezentowania odbiorcom usługi reklam opartych na profilowaniu w myśl przepisów RODO z wykorzystaniem szczególnych kategorii danych osobowych (np. danych dot. stanu zdrowia lub poglądów politycznych).

Stosowanie przejrzystego systemu rekomendacji

Dostawcy platform internetowych, którzy korzystają z systemów rekomendacji, w prostym i przystępnym języku określają w swoich warunkach korzystania z usług główne parametry stosowane w ich systemach rekomendacji, a także wszelkie opcje zmieniania tych parametrów przez odbiorców usługi lub wpływania na nie.

W głównych parametrach wyjaśnia się, dlaczego niektóre informacje są sugerowane odbiorcy usługi. Obejmują one co najmniej:

- kryteria, które są najistotniejsze przy określaniu informacji sugerowanych odbiorcy usługi; oraz

- udział poszczególnych parametrów („ile ważą”) przy ustalaniu rekomendacji dla użytkownika.

Innymi słowy, dzięki temu powinniśmy wiedzieć, że często wyświetlają nam się na platformie zdjęcia śmiesznych kotów, ponieważ oglądamy bardzo dużo filmików z nimi w udziale 😊

Jeżeli dostępnych jest kilka opcji dla systemów rekomendacji, które określają względną kolejność informacji przedstawianych odbiorcom usługi, dostawcy udostępniają również funkcję umożliwiającą odbiorcy usługi wybór i zmianę w dowolnym momencie preferowanej opcji. Ta funkcja musi być bezpośrednio i łatwo dostępna w określonej sekcji interfejsu internetowego platformy internetowej, w której informacje są szeregowane.

Ochrona małoletnich w internecie

Ostatnim obszarem obowiązków, jakie spoczywają na dostawcach platform internetowych, związana jest z korzystaniem z ich usług przez osoby małoletnie. Są to następujące obowiązki:

- wprowadzenie odpowiednich i proporcjonalnych środków, aby zapewnić wysoki poziom prywatności, bezpieczeństwa i ochrony małoletnich w ramach świadczonych przez dostawców usług (bardzo pomocne są tutaj rozwiązania wypracowane w RODO);

- zakaz prezentowania przez dostawców na swoim interfejsie reklam opartych na profilowaniu z wykorzystaniem danych osobowych odbiorcy usługi, jeżeli wiedzą z wystarczającą pewnością, że odbiorca usługi jest małoletni.

Wypełnianie powyższych obowiązków nie zobowiązuje dostawców platform internetowych do przetwarzania dodatkowych danych osobowych w celu oceny, czy odbiorca usługi jest małoletni.