Pojazdy autonomiczne to jedna z najbardziej rewolucyjnych technologii w branży motoryzacyjnej, która budzi zarówno entuzjazm, jak i wątpliwości prawne. Jednym z kluczowych pytań, które stawiają eksperci i legislatorzy, jest kwestia odpowiedzialności za szkody wyrządzone przez te nowoczesne środki transportu. Chociaż rozwój pojazdów autonomicznych obiecuje poprawę bezpieczeństwa na drogach, nieuniknione stają się wyzwania prawne związane z ustaleniem, kto poniesie odpowiedzialność za ewentualne wypadki. Czy dotychczasowe polskie regulacje i zasady odpowiedzialności są wystarczające w kontekście nowych technologii? W artykule tym analizujemy, jak obowiązujące przepisy odnoszą się do zasad naprawiania szkód wyrządzonych przez pojazdy autonomiczne i jakie zmiany mogą być niezbędne, by zapewnić odpowiednią ochronę społeczną i gospodarczą w erze cyfrowych innowacji w transporcie.

Odpowiedzialność cywilna posiadacza pojazdu – zasada ryzyka a pojazdy autonomiczne

W polskim prawie podstawą odpowiedzialności za szkody komunikacyjne jest art. 436 Kodeksu cywilnego, który przewiduje odpowiedzialność na zasadzie ryzyka. Oznacza to, że posiadacz mechanicznego środka komunikacji odpowiada za wyrządzone szkody niezależnie od winy. Zasadniczo więc, nawet w przypadku pojazdu autonomicznego, to jego posiadacz może zostać uznany za podmiot odpowiedzialny.

Czy ta zasada jest wystarczająca w kontekście pojazdów, które funkcjonują bez udziału człowieka? Z jednej strony – tak. Pojazdy te wciąż stanowią zagrożenie na drodze, chociażby ze względu na masę, prędkość czy możliwość awarii systemu. Z drugiej strony – udział człowieka w ich użytkowaniu jest minimalny, co stawia pod znakiem zapytania sprawiedliwość przypisywania odpowiedzialności bezpośrednio użytkownikowi czy właścicielowi.

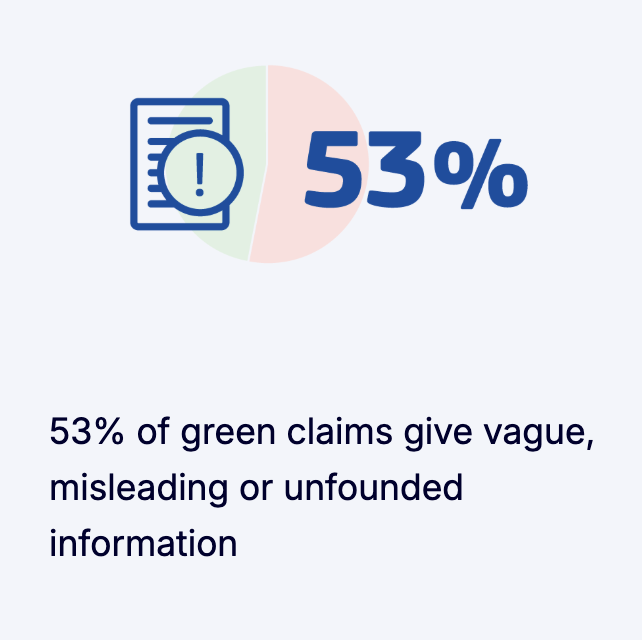

Warto także zauważyć, że statystyki wypadków drogowych w Polsce pokazują, iż główną przyczyną zdarzeń drogowych pozostaje czynnik ludzki (91% wypadków w 2023 roku. Dla porównania, wypadki wynikłe z awarii technicznych i pozostałych, nie zawinionych przez człowieka przyczyn, stanowiły tylko 2,5% [1]). Jednak, w przypadku pojazdów autonomicznych, wciąż istnieje ryzyko błędów algorytmów, awarii komponentów, problemów z łącznością, a także naruszeń cyberbezpieczeństwa, co może prowadzić do sytuacji, w których nie da się uniknąć wypadków. Technologie autonomiczne nie eliminują więc ryzyka całkowicie, a same pojazdy wciąż stanowią zagrożenie. choćby z uwagi na swoją masę i prędkość.

Egzoneracja posiadacza i rola siły wyższej

Pojawia się pytanie o adekwatność przesłanek egzoneracyjnych w kontekście autonomicznych środków transportu. Tradycyjnie, siła wyższa mogła być podstawą wyłączenia odpowiedzialności. W przypadku nowoczesnych pojazdów, które komunikują się z infrastrukturą i są zdolne do wykrywania nadzwyczajnych zjawisk, zastosowanie tego wyjątku może być ograniczone. Co więcej, awarie techniczne z reguły nie są uznawane za siłę wyższą, a ryzyko ich wystąpienia obciąża właściciela pojazdu.

Wina kierowcy a poziom autonomizacji pojazdu

W polskim prawie istnieje szczególny przypadek odpowiedzialności za szkody komunikacyjne, uregulowany w art. 436 § 2 Kodeksu cywilnego. Jest to odstępstwo od odpowiedzialności na zasadzie ryzyka, które wprowadza zasadę winy w przypadku zderzeń pojazdów (dotyczy to jedynie wzajemnych roszczeń posiadaczy) lub tzw. przewozu z grzeczności. Takie rozwiązanie rodzi istotne wątpliwości prawne, zwłaszcza w kontekście pojazdów autonomicznych.

Pojazdy autonomiczne o wysokim poziomie autonomiczności zostały zaprojektowane w sposób, który uniemożliwia użytkownikowi przejęcie kontroli nad pojazdem. To wyklucza przypisanie odpowiedzialności za błędy w prowadzeniu pojazdu lub nakładanie obowiązków, które mogłyby być później rozpatrywane pod kątem zawinienia w ramach obecnych przepisów drogowych. Takie przypadki mogą prowadzić do braku możliwości przypisania winy – trudno bowiem stworzyć przejrzyste i sprawiedliwe kryteria oceny zachowania pasażera pojazdu. W kontekście pojazdów autonomicznych wyjątkiem mogą być jedynie skrajne przypadki, jak np. celowe uszkodzenie pojazdu.

Problem pojawia się również w sytuacjach, gdy pojazdy autonomiczne wymagają przejęcia kontroli przez użytkownika w sytuacjach awaryjnych. To może wprowadzać niejasności dotyczące obowiązków osoby przebywającej w pojeździe oraz jej roli jako „doraźnego” kierowcy. W praktyce odpowiedzialność za szkody spowodowane przez autonomiczne pojazdy mogłaby być przypisana tylko w dość wąskich przypadkach, np. gdy użytkownik nie przejął kontroli w porę.

Dodatkowo, w przypadku kolizji z udziałem pojazdów tradycyjnych oraz autonomicznych, obecna regulacja prawna może prowadzić do niesprawiedliwych konsekwencji. Odpowiedzialność posiadacza tradycyjnego pojazdu będzie łatwiejsza do wykazania i wyegzekwowania, czego nie można powiedzieć o roszczeniach kierowanych przeciwko posiadaczowi pojazdu autonomicznego. W takich przypadkach proponowane są rozwiązania alternatywne, jak przypisanie odpowiedzialności posiadaczowi pojazdu autonomicznego niezależnie od winy, w drodze wyjątku.

Odpowiedzialność producenta za pojazd autonomiczny jako produkt niebezpieczny

Wreszcie, odpowiedzialność producenta za produkt niebezpieczny może być analizowana w kontekście pojazdów autonomicznych. Zgodnie z Kodeksem cywilnym, Dyrektywą 85/374/EWG oraz nowo przyjętą, ale jeszcze niezaimplementowaną Dyrektywą PLD (2024/2853), odpowiedzialność producenta opiera się na zasadzie ryzyka, co oznacza, że producent odpowiada za szkody niezależnie od winy. Odpowiedzialność ta może również obejmować inne podmioty zaangażowane w produkcję lub dystrybucję pojazdów, takie jak wytwórcy materiałów czy importerzy (nowe przepisy rozszerzają ten katalog).

W kontekście pojazdów autonomicznych oznacza to, że odpowiedzialność za szkody może zostać przeniesiona na ich producentów, którzy czerpią korzyści z wprowadzania tych technologii na rynek. Taki reżim ma na celu skłonienie producentów do tworzenia bezpieczniejszych rozwiązań, które zminimalizują ryzyko wypłaty odszkodowań.

Podstawą zastosowania przepisów o odpowiedzialności za produkt niebezpieczny jest określenie, czy pojazdy autonomiczne mogą być uznane za takie produkty. Produkt uznaje się za niebezpieczny, gdy nie zapewnia oczekiwanego poziomu bezpieczeństwa w normalnym użytkowaniu. W przypadku autonomicznych pojazdów zaawansowana technologia nie zwalnia ich z tego kryterium. Wręcz przeciwnie, skomplikowana konstrukcja tych pojazdów przemawia za objęciem ich surowym reżimem odpowiedzialności.

Choć obecne przepisy mogą mieć pewne niedoskonałości, które zostaną częściowo usunięte przez nowe regulacje, odpowiedzialność producenta niezależna od winy, w połączeniu z dodatkowymi rozwiązaniami, jak obowiązkowe ubezpieczenie odpowiedzialności cywilnej, mogłaby stanowić skuteczny sposób kompensacji szkód spowodowanych przez nowoczesne technologie.

Operator systemu AI – nowy podmiot odpowiedzialny?

W Rezolucji Parlamentu Europejskiego z 2020 r. dotyczącej odpowiedzialności cywilnej za sztuczną inteligencję, pojawia się koncepcja wprowadzenia nowej kategorii podmiotu – operatora systemu sztucznej inteligencji.

Operator, który zarządza systemem AI – czy to od strony front-endu, czy back-endu – mógłby odpowiadać na zasadzie ryzyka za wszelkie szkody spowodowane przez fizyczne bądź wirtualne działania systemu sztucznej inteligencji wysokiego ryzyka, jak również urządzeń oraz procesów z wykorzystaniem owego systemu – a więc również z wysokim prawdopodobieństwem pojazdów autonomicznych. Za szkody wyrządzone przez pozostałe systemy operator miałby natomiast odpowiadać zgodnie z zasadą winy, przy czym nie można byłoby uchylić się na podstawie stwierdzania, że szkoda powstała w wyniku autonomicznego działania systemu.

To otwiera pole do stworzenia nowej, bardziej elastycznej kategorii odpowiedzialności, która mogłaby obejmować zarówno użytkowników, jak i podmioty zarządzające systemem AI.

Wciąż jednak brakuje precyzyjnej definicji „operatora”, a zakres jego obowiązków jest w dalszym ciągu przedmiotem debaty – czy będzie sprawował bieżącą kontrolę nad algorytmem zintegrowanego ruchu pojazdów, czy też będzie przypisany do konkretnego urządzenia, jako swego rodzaju indywidualny „opiekun”.

Pojawiają się również pomysły stworzenia funduszu kompensacyjnego lub objęcia tej grupy obowiązkowym ubezpieczeniem OC. Taki fundusz mógłby być finansowany przez producentów, użytkowników pojazdów oraz przedsiębiorstwa zajmujące się car-sharingiem, jednak kwestia jego szczegółowego funkcjonowania jest na razie przedmiotem raczej abstrakcyjnych rozważań.

Potrzeba zmian legislacyjnych – przyszłość regulacji prawnych

Pojazdy autonomiczne, jako technologie wysokiego ryzyka, wymagają nowego podejścia legislacyjnego. Eksperci wskazują na konieczność:

- dostosowania przepisów Kodeksu cywilnego do realiów autonomicznego transportu;

- stworzenia precyzyjnej definicji „operatora systemu AI”;

- rozszerzenia katalogu podmiotów odpowiedzialnych;

- opracowania systemu obowiązkowych ubezpieczeń OC dla pojazdów autonomicznych i podmiotów zaangażowanych w ich obsługę;

- rozważenia utworzenia funduszu odszkodowawczego.

Podsumowanie: odpowiedzialność za szkody w erze autonomicznego transportu

Kwestia odpowiedzialności za szkody wyrządzone przez pojazdy autonomiczne to problem, który wciąż nie ma jednoznacznych rozwiązań. Obecne przepisy nie nadążają za dynamicznym rozwojem technologii, zwłaszcza gdy mowa o pojazdach o wysokiej autonomizacji. Tradycyjna odpowiedzialność oparta na winie wydaje się tu nie wystarczająca, a konieczność wprowadzenia odpowiedzialności obiektywnej staje się coraz bardziej oczywista. Istnieje także potrzeba zdefiniowania roli operatorów tych pojazdów i doprecyzowania ich ewentualnych zobowiązań. Ważne będzie również dostosowanie przepisów o ubezpieczeniach, by zapewnić skuteczną kompensację szkód. Cały ten proces wymaga elastyczności w przepisach, które powinny uwzględniać zarówno technologiczną rewolucję, jak i ochronę interesów osób poszkodowanych.

[1] Komenda Główna Policji, Biuro Ruchu Drogowego, Wypadki drogowe w Polsce w 2023 roku, https://statystyka.policja.pl/st/ruch-drogowy/76562,wypadki-drogowe-raporty-roczne.html, s. 25.